Big Data

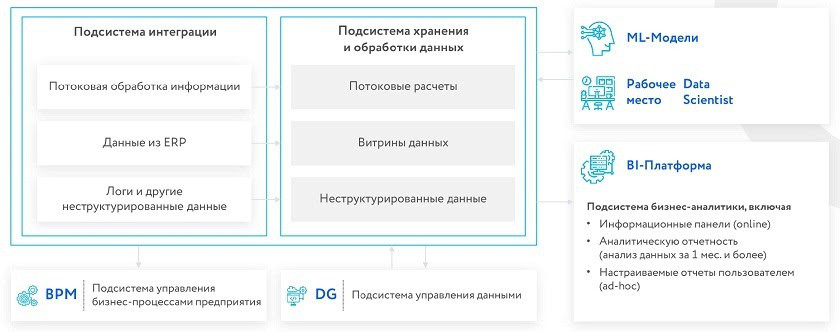

Компоненты комплексного проекта

- Унификация методов работы с данными

- Контроль нагрузки на кластер, журналирование и мониторинг загрузки

- Добавление новых таблиц/источников и управление загрузкой

- Различные методы извлечения данных из источника и обновления данных в хранилище. Возможность загрузки через брокер: установка агентов в источниках для безопасного извлечения корпоративных данных

- Cкоринг

- Глубокий ad-hoc анализ

- Эффективное соединение больших таблиц

- Сложные запросы обработки больших данных/сложная аналитика (включая аналитику поведения пользователей)

- Предсказательная аналитика (спрос, остатки)

- Cистемы маркетинговых кампаний, системы лояльности

- Любые типы отчетности (операционная, управленческая, обязательная регуляторная)

- Язык запросов DAX – полный аналог Power BI

- Модуль анализа и прогнозирования

- Smart Forms: сбор и визуализация разнородных данных, в том числе введенных вручную тысячами пользователей

- Мобильное приложение в AppStore и Google Play

- Рассылки регламентных отчетов любой сложности на основе шаблонов Excel. Виртуальный аналитик, понимающий естественную речь на русском языке

- Кастомизация и повторное использование виджетов на уровне JavaScript. Качественная интеграция с Python без замены UI-слоя для выполнения ML-моделей

Ключевые возможности

Быстрый старт проекта

Ускорение принятия решений

Быстрая проверка гипотез

Оптимизация бизнеса

Экономия на обслуживании

Строгий SLA

Сценарии использования

В банках:

- Прогнозирование ухода клиентов и предотвращение их оттока

- Прогноз необходимого остатка наличных средств в кассах и банкоматах с точностью до 99,6%

- Рекомендации наилучших действий (next best action) сотрудникам фронт-офиса и операторам контакт-центра для роста продаж

- Противодействие мошенничеству — выявление рисков противозаконных транзакций

В промышленности:

- Прогнозирование, выявление причин и предотвращение брака на технологическом конвейере

- Мониторинг износа и амортизации оборудования (ТОИР) для экономии на обслуживании

- Оптимизация расхода дорогостоящего сырья

- Разведка залежей сырьевых ресурсов по анализу данных спутниковой и аэрофотосъемки. Оптимизация и сокращение затрат на добычу

В ритейле:

- Формирование ассортиментной матрицы и оптимизация товарных остатков

- Товарные рекомендации по анализу чека и истории покупок

- Анализ поведения клиентов на сайте в реальном времени и спасение «брошенных» корзин

- Персонализация коммуникации с пользователями во всех каналах

- Составление рейтингов поставщиков

На транспорте и в логистике

- Регулирование тарифов с учетом состояния транспортного парка, расхода на топливо и заявок клиентов

- Снижение аварийности за счет анализа данных телеметрии автомобилей

- Управление расписанием движения транспортных средств

Как мы работаем

Сопутствующие услуги

16:00

16:00

18:00

.svg)